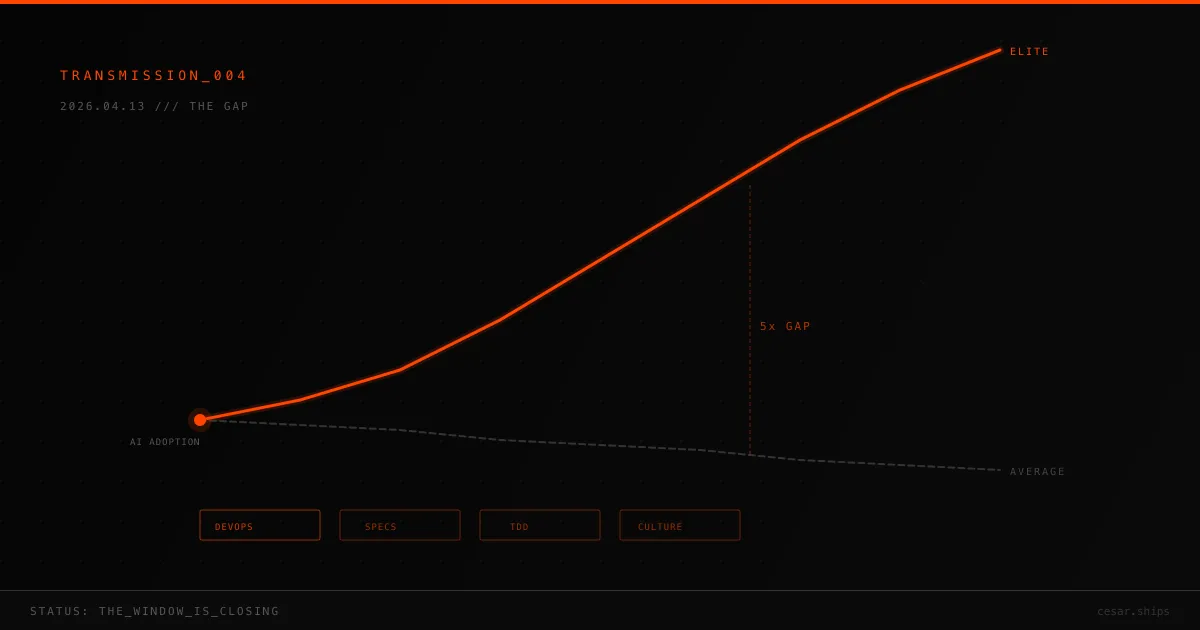

La IA está ampliando la brecha, y la mayoría de los equipos aún no lo ven

La mayoría de las conversaciones sobre IA en desarrollo de software se enfocan en lo que la IA puede hacer. La conversación correcta es sobre quién se beneficia de ella, y en qué medida.

Los datos son inequívocos. Los ingenieros senior que usan IA logran casi 5 veces más ganancias de productividad que los ingenieros junior haciendo las mismas tareas con las mismas herramientas. Las startups lean AI-native generan $3.48 millones de ingreso por empleado, comparado con $610,000 en empresas SaaS tradicionales, una brecha de eficiencia de 5.7x. El setenta y tres por ciento de los líderes de ingeniería ahora dicen que los ingenieros fuertes valen al menos 3x su compensación total, mientras que el 59% dice que los ingenieros débiles entregan valor neto cero o negativo en la era de la IA.

Ese último dato vale la pena procesarlo. No neutral. No ligeramente menos productivo. Negativo neto.

La brecha entre equipos de ingeniería de alto y bajo rendimiento siempre ha existido. La IA no la está creando. La IA la está haciendo permanente, y lo está haciendo más rápido de lo que la mayoría de las organizaciones pueden rastrear.

Por qué existe la brecha

Aquí está la parte contraintuitiva: la brecha no se trata de acceso a herramientas. Más del 90% de los desarrolladores usan herramientas de IA para programar de forma regular. Las tres plataformas dominantes, Claude Code, Cursor y GitHub Copilot, están disponibles para cualquier equipo que las quiera. Las herramientas no son el diferenciador.

El diferenciador es lo que pasa antes, durante y después de que la IA hace su trabajo.

Faros AI analizó telemetría de más de 10,000 desarrolladores en 1,255 equipos y encontró lo que llamaron la “Paradoja de Productividad de la IA”: los equipos con alta adopción completaron 21% más tareas y mergearon 98% más pull requests, pero el tiempo de revisión de PRs aumentó 91%, y no hubo mejora significativa en métricas DORA ni en KPIs de calidad. El cuello de botella no desapareció. Se movió.

Los equipos promedio usan la IA para generar más código. Los equipos de élite usan la IA para entregar más valor. No son lo mismo, y la diferencia se compone rápidamente.

La investigación de METR refuerza esto. En un ensayo controlado aleatorizado, los desarrolladores que usaron Cursor Pro con Claude en realidad completaron las tareas 19% más lento, mientras creían que eran 20% más rápidos. La brecha de 39 puntos porcentuales entre percepción y realidad no fue casualidad. Refleja un patrón: cuando usas una herramienta poderosa sin la disciplina subyacente para evaluar su output, te sientes productivo mientras das vueltas en círculos.

La base de la que nadie quiere hablar: DevOps

Esta es la parte que la mayoría de las conversaciones sobre IA se saltan por completo. Y es la parte más importante.

La investigación de Accelerate de Nicole Forsgren, Jez Humble y Gene Kim estableció algo que cuatro años de datos a través de miles de equipos hicieron innegable: los equipos de alto rendimiento sobresalen tanto en velocidad COMO en estabilidad simultáneamente. Despliegan con más frecuencia, tienen tiempos de entrega más cortos, se recuperan más rápido de las fallas y tienen tasas de fallo de cambios más bajas. Estas son las cuatro métricas DORA, y no son un lujo. Son el sustrato sobre el que todo lo demás corre.

Sin madurez en DevOps, la amplificación de la IA no solo es limitada. Es peligrosa.

Piénsalo de forma concreta. Un agente de IA genera una feature en minutos. Pero si tu equipo no tiene un pipeline de integración continua, ese código se queda en una rama por días. Si no tienes pruebas automatizadas, nadie sabe si funciona. Si tu proceso de despliegue es manual y requiere tres aprobaciones, el código espera en una cola. Si tu tiempo promedio de recuperación se mide en días en vez de minutos, cada despliegue es una apuesta.

La IA genera código a velocidad de máquina. Si tu pipeline de entrega opera a velocidad humana, con compuertas manuales, pruebas inestables y ciclos de revisión de varios días, acabas de crear el cuello de botella más sofisticado de tu organización.

La investigación de Accelerate es contundente al respecto: los cuerpos de aprobación externos disminuyen el rendimiento sin ningún beneficio de estabilidad. Los equipos que pueden elegir sus propias herramientas, desplegar de forma independiente y probar de manera autónoma superan a los equipos envueltos en procesos. Siempre.

Los equipos que despliegan bajo demanda, múltiples veces al día, con rollbacks automatizados y recuperación instantánea, esos equipos pueden realmente absorber el volumen de código generado por IA. Todos los demás se están ahogando en pull requests.

Qué hacen diferente los equipos de élite

La investigación es consistente entre empresas, tamaños de equipo y dominios. Los equipos de élite no son más inteligentes, y no están usando más IA. La están usando dentro de una cultura de ingeniería disciplinada que hace que el output sea confiable. Específicamente, hacen cinco cosas que los equipos promedio no hacen.

1. Construyen la base de DevOps primero

Integración continua. Pruebas automatizadas. Desarrollo basado en trunk. Automatización de despliegues. Monitoreo y observabilidad. Estas no son prácticas opcionales para la era de la IA. Son prerrequisitos.

La investigación de Accelerate identificó 24 capacidades concretas que impulsan tanto mejores resultados de negocio como equipos más felices y saludables. Entre ellas: control de versiones para todos los artefactos, automatización de despliegues, integración continua, desarrollo basado en trunk, automatización de pruebas, gestión de datos de prueba, seguridad shift-left y arquitectura débilmente acoplada.

Los equipos que dominan estas prácticas pueden desplegar bajo demanda, recuperarse en minutos y mantener tasas de fallo de cambios por debajo del 15%. Los equipos que las omiten están generando más código en un pipeline roto. Eso no es productividad. Es inventario.

2. Invierten el trabajo en especificaciones desde el inicio

Antes de que un agente escriba una sola línea de código, los equipos de élite invierten en especificaciones detalladas. No prompts vagos, sino planos ejecutables que definen alcance, restricciones, casos borde y criterios de aceptación. Thoughtworks llamó al desarrollo dirigido por especificaciones “una de las prácticas más importantes que emergieron en 2025.” EPAM encontró que extendió la ventana confiable de delegación de tareas de 10-20 minutos a entregas de features de varias horas sin degradación de calidad.

La especificación no es overhead. Es el punto de apalancamiento.

3. Usan las pruebas como firewall de calidad

Kent Beck, el creador de TDD, llamó al desarrollo dirigido por pruebas “un superpoder” al trabajar con agentes de IA. La razón es estructural: los agentes de IA generarán código que haga pasar las pruebas, pero también, a veces, borrarán las pruebas para hacerlas pasar. Sin una capa rigurosa de pruebas que los humanos monitoreen activamente, el código generado por IA se convierte en un problema de confianza.

Los equipos que generan mediblemente menos defectos son los que tratan las pruebas como el ciclo de retroalimentación principal, no como algo secundario.

4. Piensan en contexto, no en prompts

La maduración del desarrollo asistido por IA ha producido un nuevo concepto: ingeniería de contexto. Mientras los equipos promedio gastan energía elaborando prompts ingeniosos, los equipos de élite invierten en hacer sus codebases amigables para agentes a través de archivos AGENTS.md (ya adoptados por más de 60,000 repositorios), arquitectura de corte vertical, monorepos de un solo lenguaje y convenciones de nombres que le dan a los agentes una orientación precisa.

El cambio de “vibe coding” a “ingeniería de contexto” es el marcador más claro de un equipo que ha superado la fase experimental.

5. Se mantienen pequeños y asumen responsabilidad total

Linear opera con solo 2 product managers y equipos de 2-4 personas que se arman, entregan y disuelven. El equipo de 3 personas en el proyecto Harness de OpenAI construyó un millón de líneas de código a través de 1,500 pull requests con cero código escrito manualmente. Un estudio de McKinsey describió empresas de salud reemplazando equipos de desarrollo de 10 personas con unidades de 3: un product owner, un ingeniero con habilidades de IA y un arquitecto de sistemas.

Los equipos pequeños con responsabilidad total sobre sus problemas se mueven más rápido y acumulan menos deuda de coordinación. La IA hace que esta estructura sea viable a una escala que nunca lo fue antes.

La cultura es el sustrato

La investigación de Accelerate usa la tipología organizacional de Ron Westrum para explicar por qué las mismas prácticas producen resultados diferentes en equipos diferentes. Westrum identificó tres tipos de cultura:

- Patológica (orientada al poder): los mensajeros son castigados, las fallas se ocultan, las ideas nuevas se aplastan.

- Burocrática (orientada a las reglas): los mensajeros son tolerados, las fallas llevan a la culpa, las ideas nuevas crean problemas.

- Generativa (orientada al rendimiento): los mensajeros son entrenados, las fallas llevan a la investigación, las ideas nuevas son bienvenidas.

Los datos son claros: las culturas generativas predicen tanto el rendimiento de entrega de software como el rendimiento organizacional. Un equipo en una cultura patológica que adopta herramientas de IA para programar seguirá teniendo mensajeros castigados, fallas ocultas y sin aprendizaje compartido. El output de la herramienta nunca obtiene los ciclos de retroalimentación que necesita para mejorar.

Puedes actuar tu camino hacia una mejor cultura implementando prácticas de DevOps. Ese es uno de los hallazgos más poderosos de la investigación. Las prácticas técnicas no solo mejoran las métricas de entrega. Remodelan cómo los equipos se comunican, comparten riesgo y aprenden de las fallas. DevOps y cultura co-evolucionan. No puedes tener uno sin el otro.

El camino correctivo

Si tu equipo está del lado equivocado de esta brecha, la solución no es cambiar herramientas o contratar más ingenieros senior. Es cambiar cómo se estructura el trabajo antes de que la IA lo toque.

Empieza con tu pipeline de entrega. ¿Puedes desplegar a producción hoy, ahora mismo, con confianza? Si no, ese es tu primer problema. Automatiza tus builds. Automatiza tus pruebas. Automatiza tus despliegues. Mide tus cuatro métricas DORA: frecuencia de despliegue, tiempo de entrega de cambios, tiempo promedio de recuperación y tasa de fallo de cambios. No puedes mejorar lo que no puedes ver.

Luego invierte en especificaciones. Elige una feature próxima y escribe una especificación antes de escribir un prompt. Define cómo se ve “terminado”. Define cómo NO se ve “terminado”. Define los casos borde. Una feature con una especificación clara puede delegarse a un agente y evaluarse con precisión. Una feature sin ella no puede.

Trata tus pruebas como artefactos de primera clase. Si estás usando IA para escribir código y no estás usando pruebas para verificarlo, estás volando sin instrumentos. Cuando un agente de IA borra una prueba para hacerla pasar, quieres que eso sea un evento ruidoso y visible, no algo que se filtra sin notarse.

Audita tu codebase para que sea amigable con agentes. Míralo a través de los ojos de un agente que nunca lo ha visto. ¿Los nombres son consistentes? ¿Puede un modelo orientarse rápidamente leyendo los nombres de archivos y los límites de los módulos? La mayoría de los codebases fueron construidos para familiaridad humana, no para colaboración con IA. Cerrar esa brecha paga dividendos cada vez que un agente toca tu código.

Construye una cultura de revisión crítica. El patrón más peligroso en el desarrollo asistido por IA es la aceptación normalizada. Cuando el output de la IA deja de ser interrogado y empieza a ser aprobado por fe, los problemas de calidad se acumulan de forma invisible. El análisis de CodeRabbit encontró que el código generado por IA produce 1.7x más problemas en general y es 2.74x más propenso a introducir vulnerabilidades de cross-site scripting. Tu proceso de revisión es la última línea de defensa. Necesita ser más rápido que antes, y más riguroso.

Lo que realmente está en juego

La pregunta organizacional no es si usar IA. Esa decisión ya está tomada. La pregunta es si estás construyendo las prácticas que hacen que el output de la IA sea confiable, o si estás generando más código con los mismos problemas de siempre.

Los equipos que están ganando ahora no se distinguen por las herramientas que usan. Se distinguen por la disciplina que le aportan a esas herramientas: los pipelines de DevOps, las especificaciones, las pruebas, la claridad arquitectónica, la cultura de responsabilidad.

La IA no reemplaza esa disciplina. La amplifica. Y amplifica su ausencia con la misma fiabilidad.

La mayoría de los equipos aún no ven la brecha porque el output se ve bien. Los PRs se están mergeando. Las features se están entregando. Los dashboards se ven saludables. Pero la deuda técnica se está acumulando, la carga de revisión está creciendo, y la distancia entre esos equipos y los que operan a 5x de eficiencia se amplía cada trimestre.

La ventana para cerrarla está abierta. No va a quedarse así.

Si quieres ver cómo se ve esto a nivel individual, escribí sobre cómo los desarrolladores pueden hacer esta transición por sí mismos: De Desarrollador Full-Stack a Ingeniero de Producto Full-Stack.

Fuentes

Karat. “AI Is Widening the Engineering Skills Gap.” 2025.

Faros AI. AI Productivity Paradox analysis across 10,000+ developers and 1,255 teams.

METR. Randomized controlled trial on AI-assisted software development.

CodeRabbit. Analysis of AI-generated code quality and security vulnerabilities.

Forsgren, Nicole, Jez Humble, and Gene Kim. Accelerate: The Science of Lean Software and DevOps. IT Revolution, 2018.

Opsera (250,000+ developers), McKinsey, Insight Partners, Cortex.

With love, Cesar Ardila 🎵